Nel mese di aprile Google ha festeggiato i primi dieci anni del suo Traduttore, uno strumento sul quale gli utenti di tutto il mondo fanno quotidianamente affidamento per convertire testi (e non solo) da una lingua all’altra. Oggi il gruppo di Mountain View ribadisce che si tratta di un servizio in continua evoluzione: l’ultimo step poggia sulle potenzialità dell’intelligenza artificiale ed è spiegato sul blog ufficiale dedicato alla ricerca.

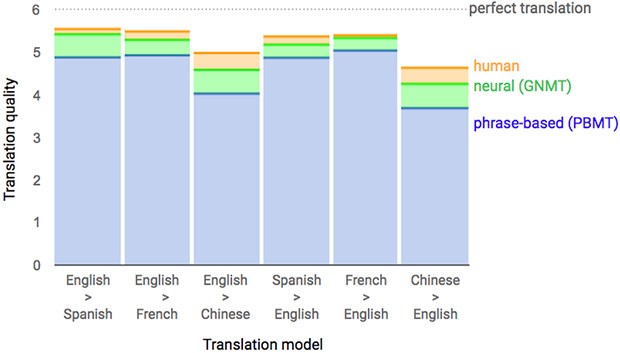

Google Neural Machine Translation (GNMT), questo il nome della tecnologia messa a punto. La novità principale, rispetto ai metodi di traduzione più tradizionali, è che invece di elaborare una parola o una singola frase per volta restituendole nelle lingua desiderata, lo fa con porzioni di testo più ampie, comprendendone il contesto e il significato intrinseco. Il risultato, in alcuni casi, si avvicina a quello ottenuto affidando l’operazione di traduzione ad un essere umano, come mostra il grafico allegato di seguito. A parlarne sono Quoc V. Le e Mike Schuster, due ricercatori del team Google Brain impegnati sul progetto.

Il vantaggio di questo approccio è che richiede meno decisioni ingegneristiche rispetto al precedente sistema di traduzione basato sulle frasi.

Un grafico mostra l’accuratezza nella traduzione condotta dal sistema GNMT e la confronta con quella di un essere umano

A partire da oggi GNMT è impiegato sulle versioni Web e mobile di Google Traduttore per tutte le conversioni da cinese a inglese, ovvero per circa 18 milioni di operazioni ogni giorno. Un tale volume di richieste permetterà di migliorarne l’efficacia, grazie al principio secondo il quale il machine learning è in grado di imparare e migliorare lo svolgimento di un compito mentre lo effettua.

Il lavoro da fare comunque non manca. Ad ammetterlo sono gli stessi ricercatori di bigG, che sottolineano come il sistema possa incontrare difficoltà quando vengono sottoposte parole utilizzate raramente o che si prestano a diverse interpretazioni. In quei casi l’algoritmo può faticare a riconoscere il contesto della frase o del discorso, inciampando in un errore che un essere umano non commetterebbe mai.

/https://www.webnews.it/app/uploads/2016/09/traduzione.jpg)

/https://www.webnews.it/app/uploads/2025/04/wp_drafter_1213570.jpg)

/https://www.webnews.it/app/uploads/2025/04/wp_drafter_1213427.jpg)

/https://www.webnews.it/app/uploads/2025/04/wp_drafter_1212961.jpg)

/https://www.webnews.it/app/uploads/2025/04/wp_drafter_1212795.jpg)