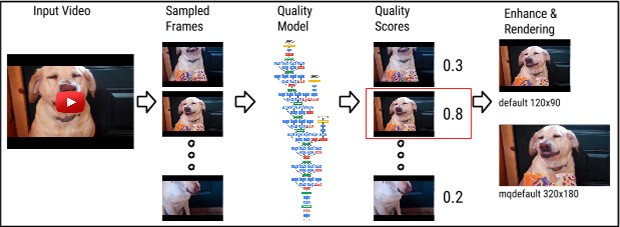

Quando si effettua il caricamento di un filmato su YouTube, la piattaforma analizza in modo del tutto automatico il video, frame dopo frame, alla ricerca di quello che può essere utilizzato come un’anteprima da mostrare agli utenti. Successivamente il creatore può scegliere una delle tre proposte formulate dal servizio oppure caricarne una propria. In futuro il sistema che si occupa di questa operazione sarà reso più smart, grazie all’impiego delle reti neurali.

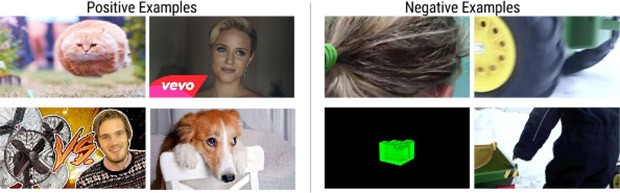

Per allenare l’algoritmo ad ottenere risultati migliori, Google gli ha fornito alcuni esempi positivi come immagini caricate dai creatori di contenuti oppure frame in cui soggetto della clip è ben visibile al centro, mentre negli esempi le cose inquadrate sono mosse, solo parzialmente visibili o non messe a fuoco. Partendo da questa premessa, il software incaricato della scelta sfrutta un metodo chiamato Binary Classification (Classificazione Binaria) per stabilire, frame dopo frame, se le immagini incluse nel video sono adatte o meno a fungere da anteprima. In altre parole, bigG impiega una tecnologia legata all’intelligenza artificiale per stabilire se un’immagine è rappresentativa per il filmato in questione.

Secondo Google, i frame giusti sono solitamente “ben inquadrati, con un soggetto specifico al centro”. Quelli estratti dalle reti neurali vengono selezionati dall’utente nel 65% dei casi, a testimonianza della bontà dell’algoritmo. Di seguito alcuni esempi per capire, in termini visivi, quale sia la differenza tra un frame adatto a rappresentare l’intero filmato e quale invece risulta poco identificativo. La novità è stata introdotta di recente e i suoi effetti non dovrebbero tardare a mostrarsi.

/https://www.webnews.it/app/uploads/2015/06/youtube.jpg)

/https://www.webnews.it/app/uploads/2025/04/wp_drafter_1213570.jpg)

/https://www.webnews.it/app/uploads/2025/04/wp_drafter_1213427.jpg)

/https://www.webnews.it/app/uploads/2025/04/wp_drafter_1212961.jpg)

/https://www.webnews.it/app/uploads/2025/04/wp_drafter_1212795.jpg)