Samsung ha annunciato lo sviluppo di nuovi algoritmi IA che permettono di incrementare le prestazioni e ridurre i consumi durante l’elaborazione locale. Tutti i calcoli sono effettuati dalla NPU (Neural Processing Unit) integrata nel processore, quindi senza accedere al cloud.

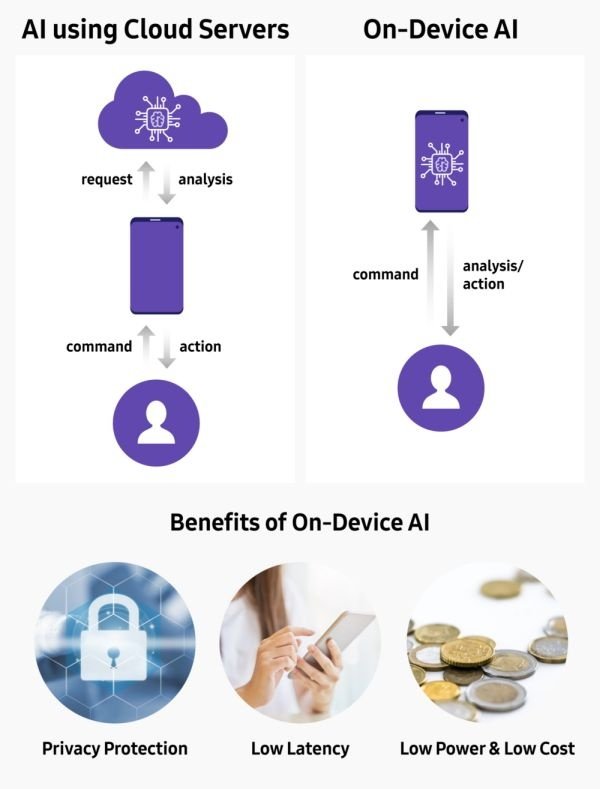

Il Samsung Advanced Institute of Technology (SAIT) ha sviluppato una tecnologia On-Device AI che offre una velocità di calcolo fino a 8 volte superiore a quella dei server a 32 bit. Gli algoritmi di deep learning, parte principale dell’intelligenza artificiale, permettono ad un computer di pensare e apprendere come un essere umano. Fino a qualche anno fa i calcoli dovevano essere eseguiti sul cloud, ma oggi possono essere elaborati direttamente sui dispositivi mobile, proprio grazie alle NPU, ottenendo vari benefici: maggiore privacy, bassa latenza, minori consumi e costi inferiori.

L’incremento di performance ed efficienza energetica è stato ottenuto suddividendo i dati in gruppi di 4 bit o meno, sfruttando una tecnica nota come Quantization Interval Learning (QIL). In questo modo è possibile eseguire migliaia di calcoli allo stesso tempo, incluse le operazioni di AND e OR, oltre alle più semplici operazioni aritmetiche di addizione e sottrazione. Con il QIL si può ridurre il numero di transistor fino a 1/120 e conseguentemente i consumi.

Exynos 9820 è stato il primo processore Samsung con NPU integrata. Questa unità di calcolo viene sfruttata per le funzionalità IA delle fotocamere della serie Galaxy S10 e per le funzionalità AR. Le operazioni saranno più veloci con la nuova tecnologia On-Device AI. In futuro gli algoritmi verranno utilizzati anche per la memoria e i sensori.

/https://www.webnews.it/app/uploads/2019/07/machine-learning.jpg)

/https://www.webnews.it/app/uploads/2025/04/wp_drafter_1212585.jpg)

/https://www.webnews.it/app/uploads/2025/04/wp_drafter_1212568.jpg)

/https://www.webnews.it/app/uploads/2025/04/wp_drafter_1212544.jpg)

/https://www.webnews.it/app/uploads/2025/04/wp_drafter_1212534.jpg)